|

|

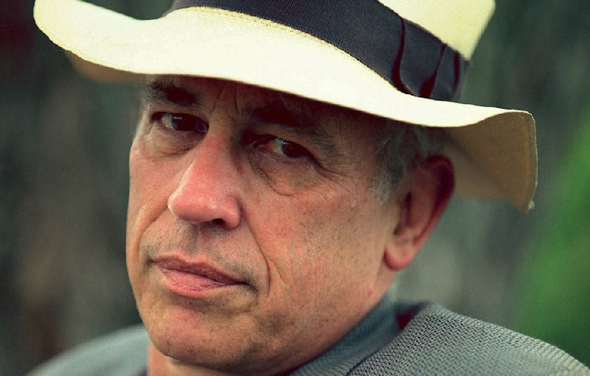

Денієл Деннет і Девід ЧалмерсЧи ж суперінтелект неможливий?РОЗМОВА ПРО МОЖЛИВІ РОЗУМИ:

ФІЛОСОФІЯ І ШТУЧНИЙ ІНТЕЛЕКТ У жовтні 2019 року більш

як тисяча людей зібралися у культурному центрі Pioneer Works у місті

Ред-Гукс, штат Нью-Йорк, щоб послухати модеровані Джоном Брокманом дебати двох

визначних сучасних філософів, Денієла

Деннета та Девіда

Чарлерcа, на тему «Чи ж суперінтелект неможливий?». Дебати відбулися

в рамках презентації книги «Можливі

розуми: 25 поглядів на штучний інтелект», редактором якої був Джон

Брокман, а серед співавторів – Деннет та Чарлерс.

Брокман: Для мене

сьогодні дуже зворушливий вечір, хоча я й не люблю показувати емоції. Ці двоє

хлопців кожен по-своєму вже понад двадцять років обговорюють дуже серйозні

ідеї. Сьогодні вони неначебто друзі. Я сподіваюсь, що вони залишатимуться ними

й надалі. Мої співрозмовники мають дуже різні

погляди на світ. Два десятиліття вони по-різному говорять про «складну

проблему» свідомості, але сьогодні про неї мова не йтиме.

Натомість ми поговоримо про наступний її можливий рубіж, а саме про стрімкий

розвиток штучного інтелекту.

Мене ця тема цікавить ще з далекого 1965 року, коли я почав активно

спілкуватись з кібернетиками. Згодом я від цього дещо втомився, і десь у 1980-х

я відійшов від світу «експертних систем». Японці, скажімо, мали МІТІ, яка була

їхньою програмою «п’ятого покоління» розвитку комп’ютерів. Багатьох людей це

дуже хвилювало: «Вони йдуть! Вони йдуть!» – кричали вони. І ось вони

прийшли. І що? Нічого не сталося! Мені трапилась нагода побувати на

ланчі у Нью-Йоркській академії наук, на якому керівник MITІ опинився поруч з

Марвіном Мінським, Джоном Макарті, Роджером Шанком, Едом Фейґенбаумом та іншими

визнаними лідерами перших двох хвиль розвитку штучного інтелекту. Згодом увесь

захват довкола програми MITI й «п’ятого покоління» штучного інтелекту досить швидко

згас. Не пройшло й двадцять років, і ми прокинулися у новій реальності штучного

інтелекту, а саме – технології глибинного

навчання, під час якого комп’ютери самі себе удосконалюють без

нагляду людини. Найкраще, мабуть, це репрезентує програма AlphaGo, розроблена

Демісом Хассабісом та його колегами з компанії DeepMind у Сполученому

Королівстві. Усе це було неймовірно цікаво. Я тоді подумав, що було б цікаво

дізнатися, що ж відбувається. Тому у квітні 2016 року я організував в Лондоні

ланч разом з Демісом. Ідея полягала в тому, щоб звести його разом з Девідом Дойчем,

одним з найпроникливіших розумів нашого часу, і, можливо, краще зрозуміти, що ж

відбувається. На ланчі також були присутні люди, які не мають нічого спільного

з комп’ютерами, але яким є що розповісти про реальність, – романіст Єн МакІвен,

музикант Браян Ено, кінорежисер Террі Ґілліам, мистецький куратор Ганс Ульріх

Обріст. Товариський обід лондонського Quality Chop House виявився

справді неймовірним початком. Відтоді ми вирішили продовжувати такі зустрічі і

надалі. У вересні 2016 року я продовжив цю

традицію і організував у Вашингтоні (штат Коннектикут) зустріч людей, які

осмислювали штучний інтелект протягом усього свого життя. Там були присутні,

зокрема, Дені Ґілліс, який своїм паралельним процесором зламав «шийку пляшки

фон Ноймана» [«шийка пляшки фон Ноймана» – це метафорична назва обмежень

продуктивності, зумовлена стандартною архітектурою персональних комп’ютерів],

Пітер Ґалайсон, історик науки, Сет Ллойд, квантовий теоретик, та Ніл

Ґершенфельд, комп’ютерний науковець з MIT, який, міркуючи над «Кібернетикою»

Норберта Вінера, сказав: «Усе, що написано в цій книзі, наділено неймовірним

даром передбачення, хоча їй вже дуже багато років. Його перестороги про нашу

сучасну культуру, про комерціалізацію науки дивним чином збуваються. Ми повинні

зробити йому послугу і переписати цю книгу». Саме так ця книга [«Можливі

розуми»] і розпочалась, і саме тому ми всі тут зібралися. Одна з тем, порушених у цій книзі,

– «Чи можливий суперінтелект?». Я думаю, що для вступу ми надамо п’ять

хвилин кожному з присутніх тут джентльменів. Першому я б хотів надати слово

Девіду.

Чалмерс: Для мене велика

приємність сьогодні тут виступити. Дуже дякую Джону та Джанні за організацію

цієї події. Це буде цікаво! Я здогадуюсь, що одне з питань на сьогоднішньому

вечорі буде таким: суперінтелект – можливий чи неможливий? Я на боці того,

що можливий. Я люблю усе можливе, і це одна з причин, чому мені подобається те,

як Джон сформулював заголовок книги. Це чудовий спосіб думати про інтелект – як

природний, так і штучний, – а також про природну і штучну свідомість. Простір

можливих розумів неймовірно широкий – це усі розуми, які коли-небудь існували,

існують або можуть існувати. За певними підрахунками, у світі за увесь час жили

100 мільярдів людей зі власними розумами. Серед них були і справді унікальні –

Конфуцій, Ісаак Ньютон, Пабло Пікассо, Мартін Лютер Кінґ і т. д. Але

навіть ці сто мільярдів людей, зібрані разом, є лишень невеличким фрагментом

множини усіх можливих розумів. Ми можемо додати сюди розуми усіх

тварин, які коли-небудь жили. Я провів невеликий пошук в інтернеті і натрапив

на цифру, що за усю історію нашої планети на ній побували 10²⁹

тварин. Більшість із них були дуже примітивними, а їхні розуми – не надто

цікавими, але натомість 10²⁰ були дуже, дуже цікавими. А як

щодо комп’ютерів? Найнеймовірніша річ про комп’ютери – це те, що саме вони

дозволяють нам міркувати про можливі розуми. Адже саме завдяки їм, можливо,

уперше в історії нашої планети почали існувати цілком нові види розуму, які

з’явилися не в результаті стандартного процесу біологічної еволюції, а

внаслідок прямого, навмисного задуму і програмування. Джон згадав про AlphaGo та успіх

покоління AlphaZero, яка змогла сама себе навчити грати в гру Ґо так само, як

це зробила би людина. Програма при цьому ще й значно розширила людську

майстерність – поки що у вузькому й дуже обмеженому діапазоні гри в Ґо.

Глибинне навчання досягнуло вражаючих успіхів і у розпізнаванні зображень,

мови, а також автономного керування автомобілями, хоча ера самокерованих авто

цілком ще не настала. Принаймні у розпізнаванні мови й зображень штучний

інтелект починає перевершувати людські можливості. Отже, ми маємо невелике розширення

простору можливих розумів, яке охопило ті розуми, які ми вже створили. Але поки

що це ще дуже маленьке розширення. Те, чого ми категорично зараз не повинні

робити, – це перебільшувати ті досягнення, яких нам наразі вдалося досягнути зі

штучним інтелектом. Вони великі, але поки що дуже обмежені. Вони ще й

близько не довели нас до можливостей людського розуму, і малоймовірно, що

доведуть у близькому майбутньому. Цього точно не станеться у найближчих

двадцять років, але чи дійдемо ми до них протягом століття? Можливо. Кажуть, що люди мають схильність

переоцінювати ефекти технологій у короткій перспективі й недооцінювати у

довгій. Це і передає моє ставлення до штучного інтелекту. Тепер довкола нього

дуже багато шуму. Він повністю не змінить нашого життя упродовж наступних

двадцяти років, але у наступні два століття, можливо, він змінить усе. Одна з

причин цього полягає у тому, що штучний інтелект поступово вбудовується у цей

простір можливих розумів, який сам себе пізнає і розширює. Спочатку вам

потрібно було програмувати штучний інтелект самостійно. Ще Алан Тюринг написав

програму, яка містила декілька дуже простих правил для гри в шахи. І ця

програма справді грала в шахи, хоча й поганенько. Тепер такі програми, як

AlphaGo, самі вчаться грати в ігри і роблять це напрочуд добре. Навчання – це спосіб рухатися далі у

цьому просторі можливих розумів. Розпочніть із простого розуму і його здатності

вчитися, і він кудись дійде. Еволюція є одним із таких методів. Я очікую, що

невдовзі штучний інтелект використовуватиме еволюційні методи й ми

побачимо якийсь різновид штучної еволюції, що, можливо, піде дивовижними і

непередбачуваними шляхами далеко від вихідної точки. Навчання та еволюція

комп’ютерів – це спосіб розширення цього спектра можливих розумів. Але найпотужніший аспект цієї

штучної еволюції ще повинен настати. Він прийде тоді, коли штучний інтелект

програмуватиме сам себе. Іншими словами, штучний інтелект створюватиме штучний

інтелект. Уявіть, що ми досягнули першого такого штучного інтелекту, який

матиме людську здатність мислити універсально, а не в якомусь вузькому

діапазоні, і, зокрема, сам умітиме створювати штучний інтелект. Десь за рік або

два – ці речі блискавично удосконалюються – цей «штучний штучний інтелект» буле

набагато кращим, ніж штучний інтелект, створений людиною. Далі він створюватиме

нові форми штучного інтелекту, які знову і знову перевершуватимуть самих

себе. Отже, люди його створили, а він створить щось краще. Цей процес

рекурсивного самовдосконалення штучного інтелекту першим обґрунтував філософ та

статистик Ірвінг Джон Ґуд, і я вважаю його неймовірним способом міркування про

простори можливих розумів. Тож ми розпочинаємо із нашого

маленького куточка у просторі можливих розумів, а згодом шляхом навчання та

еволюції він розширюється до нових і нових горизонтів. Поки що це усе ще дуже

невеликий куточок, але штучні інтелекти, які ми вже створюємо, можуть допомогти

створити набагато досконаліші версії. Вони рухатимуться у ширший простір, а ті

– у ще ширший і т. д. Зрештою, усе це може призвести до появи систем, порівняно

з якими ми виглядатимемо, як миші. Це буде справжній суперінтелект. Це можливо.

Але я думаю, що цього не станеться у найближчі двадцять чи навіть п’ятдесят

років. Згідно з робочим визначенням,

інтелект – це здатність досягати широкого спектра цілей та розв’язувати

проблеми. Ці штучні інтелекти будуть системами, які зможуть досягати своїх

цілей неймовірно потужними способами, якщо, звісно, у них будуть свої цілі.

Якщо їх якось не обмежити, я думаю, що вони їх таки досягатимуть. Тому ми

повинні бути дуже обережними. Якими будуть цілі штучного інтелекту? Як

філософи, ми маємо думати про цінності. Але якими цінностями нам належить

програмувати штучний інтелект? Нам належить також думати про свідомість. Чи ці

штучні розуми «свідомі»? Чи їхня «свідомість» якось пов’язана з людською? Чи вони

перетворяться у світ неймовірно підсилених людських переживань, чи, можливо, це

будуть світи узагалі без свідомості? Можливо, ми поговоримо про це під час

нашої дискусії. І останнє питання полягає у тому, на

якому рівні ми, люди, стоїмо щодо цих систем штучного інтелекту? Чи вони

замінять нас, чи, можливо, лише підсилять? Чи зрештою ми самі станемо штучним

інтелектом? Чи ми розширимо свої здібності? Чи завантажимо свою свідомість у

комп’ютер? Порівняно зі сценаріями, за якими люди узагалі перестануть існувати,

це може бути навіть досить привабливою альтернативою. Чи узагалі можливо

завантажити людський розум в комп’ютер? Усе це підіймає деякі найстаріші

філософські запитання про свідомість та ідентичність. Тож дуже добре, що Джон

вирішив звести тут декількох філософів, науковців та інженерів, щоб поміркувати

над цими питаннями. Брокман: Дякую!

Я повинен додати, що Дейв — це професор філософії та нейронауки, а також

співдиректор Центру вивчення розуму, мозку та свідомості Нью-Йоркського

університету. Денієла Деннета, думаю, не потрібно представляти. Чалмерз: Я

вимагаю, щоб ви таки представили. Брокман: Ден

Деннет — це професор філософії та директор Центру когнітивних студій при

Університеті Тафтса.

Деннет: Дякую

вам, Джоне! Дякую вам, Девіде! Це мають бути дебати, але у тому, що щойно

сказав Девід, майже немає чогось такого, з чим би я не погодився, хоча я поки

що не акцентуватиму на цьому «майже». Поговорімо спершу про «можливе». Є

багато речей, які можливі, утім – філософи люблять це підкреслювати – не все

можливе стає дійсним. Можливо, наприклад, побудувати міст через Атлантичний

океан, але ми цього не зробимо ані зараз, ні через тисячу років. Такий проєкт

був би дуже дорогим і став би жахливою затією. Чимало проєктів штучного

інтелекту, які можливі в принципі, не вартують того, щоб їх втілювати. А деякі

ми узагалі не повинні створювати, адже вони принесуть набагато більше проблем,

ніж користі. Інколи говорять, що філософи – це

ті, хто кажуть: «ми знаємо, що це можливо на практиці, тож потрібно з’ясувати,

чи це можливо в принципі». На жаль, вони часто витрачають дуже багато часу на

роздуми про логічні проблеми, які абсолютно незначні в усіх інших аспектах. Тож

дозвольте мені запам’ятатися фразою: так, я думаю, що свідомий штучний інтелект

можливий, оскільки чим же зрештою є ми самі? Ми свідомі. Ми – роботи, зроблені

з роботів, які зроблені з інших роботів. Ми актуальні. Теоретично нас можна

зробити з інших матеріалів. Деякі наші найкращі друзі в майбутньому, можливо,

будуть роботами. Усе це можливо в принципі й не потребує якихось секретних

інґредієнтів, але ми цього не побачимо. І для цього є декілька вагомих

причин. Одна з них полягає в тому, що якщо вам потрібен свідомий суб'єкт, то

навколо їх і так дуже багато. Усі вони чудові, тоді як ті, які ми створимо,

зовсім не будуть такими чудовими. Один з найбільших страхів перед

майбутнім, на мою думку, полягає у тому, що перш ніж ми дійдемо до

суперінтелекту, настане епоха людей, які будуть дуже залежними від

не-суперінтелекту, причому настільки, що ми станемо дуже вразливими. Можна

сказати, що проблема GPS в майбутньому дуже підсилиться. Люди більше не вміють

читати карти і гадки не мають, як кудись заїхати без GPS. Я впевнений, що ця

залежність від технологій у житті багатьох людей в майбутньому лише зростатиме. Чи є хтось в цій кімнаті, хто знає

алгоритм видобування квадратного кореня? Я знав його ще у школі, десь у восьмому класі. Це цілком можливо зробити за допомогою

паперу і ручки, якщо знати алгоритм, який більше ніхто вже не хоче вчити. Щоб

добути квадратний корінь, усе, що вам тепер потрібно, це лише натиснути кнопку

на калькуляторі. Багато важливих сьогодні талантів атрофуються і житимуть хіба

в руках дивакуватих ремісників, як, наприклад, тих, які і досі знають, як

викувати підкову. Лише поодинокі люди в майбутньому знатимуть, як читати карти,

керувати автомобілем і робити ще інші «дивні» речі, які більшість на той момент

вже забуде. Саме це мене й турбує. Ще більше мене турбує те, що ми з

найкращих міркувань скинемо із себе відповідальність за прийняття важливих

рішень і делегуємо їх штучному інтелекту, який ані свідомий, ні «супер». Він є

лишень дуже хитримудрим інструментом, який дозволяє нам, наприклад,

розпізнавати зображення. Хто ще двадцять років тому міг подумати, що

існуватимуть такі речі? Зараз вони є, але коли ви починаєте делегувати важливі

рішення системам, які є лишень розумними інструментами, то це змінює наше

людське становище дуже непростим способом. Моє ставлення до усього цього

полягає у тому, що нам потрібні розумні інструменти, але не штучні друзі.

Різниця між ними у тому, що штучний друг – це хтось, хто міг би взяти на себе

моральну відповідальність чи стати співавтором наших рішень. Ми і близько не

наближаємось до цього зі штучним інтелектом. Алан Тюринг, один з моїх героїв усіх

часів, зробив якось те, чого не слід було робити. Знаменитий тест Тюринга винагороджує

обман, адже у ньому потрібно переконати людей, що вони спілкуються з людиною, а

не роботом. Це була справді хороша ідея, але відтоді преміями нагороджують тих,

хто здійснює те, що я називаю «діснеїфікацією» штучного інтелекту, тобто

роблять його дедалі подібнішим на людей. Але це загалом хибна реклама. Коли ми

говоримо про «Сірі», «Ватсона» чи щось

схоже, то усі вони мають цей дуже тонкий, наче папір, користувацький інтерфейс,

який вводить в оману, буцімто вони щось там розуміють. Але це хибна реклама. Це

слід не винагороджувати, а радше критикувати та засуджувати. Нам потрібно позбутися звички

ставитися до штучного інтелекту як до суб'єкта, адже він ним за суттю не

є. Причина, чому це буде складно, полягає у тому, що багато людей прогнозують,

що важливою нішею для штучного інтелекту стане догляд за старенькими. А чому б

і ні? Доглядати за старшими людьми, які не можуть пильнувати за собою самі, не

є добрим життям для звичайної людини. Це, можливо, навіть гірше, ніж бути

старосвітським телефонним оператором. Ми не шкодуємо про втрату цих професій.

Догляд за старенькими може бути і справді доброю підставою для «діснеїфікації»

штучного інтелекту, адже вони хотітимуть бачити біля себе компаньйона, а не

лише когось, хто їх годуватиме чи чиститиме їм зуби. Утім, мені не подобається

майбутнє, в якому мільйони старших людей проводитимуть час з цими штучними

«компаньйонами», які у багатьох важливих аспектах є фейками. Брокман: Дякую! Чалмерс: Ми тут

погоджуємося у багатьох питаннях, але, можливо, у нас є незгода щодо ключового

питання: чи існуватиме, власне, автономний суперінтелект? Ден у своїй частині

книги написав про це дуже ясно і вдумливо. Він вважає, що хоча й можливо

створити автономний, розумний та свідомий штучний інтелект, ми все-таки не

повинні цього робити і, можливо, ніколи цього й не зробимо. Натомість він

вважає, що нам потрібно створювати знаряддя. Він використовує цю чудову

аналогію з картами Google, які вказують вам, як кудись дістатись, але вам

все-таки потрібно самотужки туди доїхати. Карта може показати вам дорогу, але

вам усе ще потрібно прийняти рішення, чи їхати цієї дорогою. Людина досі

залишатиметься в цій системі. Ви отримали певну пораду, але вам самим потрібно

вирішити, чи прийняти її. Саме так я бачу Денову візію штучного інтелекту.

Можливо, ми матимемо в майбутньому суперінтелект, який підказуватиме нам, як

полетіти на Марс або виграти якусь війну. Штучний інтелект зможе підказати, що

потрібно зробити, але рішення все-таки залишатиметься за нами. Це прекрасна візія, але я маю

сумніви, що вона реалістична. Відбуватиметься величезна кількість спроб таки

вийняти людину з цієї системи і передати штучному інтелекту здатність автономно

діяти на основі власних порад. Власне, це вже відбувається з картами Google та

навігаційними програмами. В самокерованих автомобілях, таких як Tesla, ви

досить довго вказували їм пункт призначення, а вони вже самі пропонували вам

декілька маршрутів, з яких вам належало вибрати той, яким їхати. Згодом

інженери запровадили функцію «навігація за автопілотом», завдяки якій машина

вже сама обирає для себе інструкції і рухається за ними. Вона сама обертає

кермо і обирає смугу руху. Є, звісно, обмеження, адже така машина ще

наразі не може рухатись звичайними міськими вулицями. В одній невеликій сфері ми вже

бачимо, що машина стала обмежено автономною. Вона має свої цілі і самостійно

діє, щоб їх досягнути. Так, ми досі можемо цю машину зупинити і скерувати до

іншого місця, але коли я міркую, наприклад, про автономну зброю на полі бою, то

поки що ставки низькі, ми і справді матимемо лише системи, які тільки

радитимуть солдату, яку ціль вибрати. Але коли штучний інтелект почне

виконувати ці завдання набагато краще і швидше за людину, то у військових

одразу з’явиться спокуса створити і використати на полі бою повністю автономні

системи, особливо з огляду на те, що ставки військового конфлікту дуже високі. Як порівняти із супершвидкими

роботами, біологічні системи в кінцевому підсумку виявляться дуже повільними і

вразливими. У фінансовій (фондовий ринок) та військовій сферах й навіть у науці

стимули запровадити такі системи будуть дуже високими. Уникнути автономії буде

дуже непросто. Якщо в цьому буде інтерес урядів чи технологічних компаній, то,

звісно, це станеться. Тож я не думаю, що є шанси цього уникнути. Деннет: Ви

порушуєте справді важливі питання, які полягають у тому, скільки автономії ми

хочемо надати цим системам. Ми не хочемо, щоб самокеровані автомобілі,

наприклад, були аж надто автономними. У Dilbert недавно

з'явився комікс, в якому автономна машина заявила головному герою: «Я хочу, щоб

мене називали Карл. Самокероване авто – це моє рабське ім’я». Герой відповів:

«Заткнись і вези мене в магазин». А машина йому на те: «...Сказала самоходяча

людина». Ми не хочемо аж такої автономії.

Автономія – це синонім свободи волі, і я не хотів би навіть думати, що ми

зможемо надати штучному інтелекту повну автономію, адже технології мають певну

невразливість, якої ми, люди, не маємо. Ви можете щось скопіювати і знову

скласти докупи або зробити нову копію в понеділок, але якби нас, людей, так

само можна було копіювати і відновлювати, це б драматично змінило природу

людських відносин. Я не хочу, щоб щось подібне сталося, і думаю, що багато

людей теж цього не хочуть. Тож якщо ви маєте рацію, що ринковий

тиск і справді вестиме нас до автономного штучного інтелекту, то нас чекає дуже

похмуре майбутнє. Що може статися? Наприклад, ми надамо йому більше автономії,

ніж йому потрібно, і саме цього я боюся. Брокман: Кароліна

Джонс, одна з есеїсток в нашій книзі, надіслала питання, яке стосується нашої

залежності від комп’ютерного погляду на світ. Вона запитує: «Чи могли би ви

поміркувати про складність нашого "сирого" пізнання, тобто радше

‘децентралізованого’ погляду на інтелект, що виходить за межі ідей про

обчислення. З цього погляду, що таке смерть робота? І чи за відсутності

смертності може існувати належна етика штучного інтелекту?» Цей

«обчислювальний» погляд здебільшого стосується Західного узбережжя. Кібернетики

– Вінер, Шеннон, МакКалок, фон Нойман – мали радше екологічний погляд на те, як

різні елементи штучного інтелекту поєднуються і взаємодіють між собою. Чалмерс: Це

чудове питання, і ми цілком можемо пов’язати його з нашою дискусією. Щодо того,

чи є у штучного інтелекту життя і смерть й що таке автономія комп’ютера, Ден

сказав, що автономія потребує свободи волі. У цьому випадку нам потрібно давати

собі раду з усіма філософськими питаннями, які стосуються свободи волі. Чи ви

справді вважаєте, що ми можемо вирішити питання про те, чи має штучний інтелект

свідомість чи свободу волі? Це – великі філософські проблеми. Для питань

безпеки і людського виживання набагато важливіше те, що ці системи зможуть

робити, а не їхні властивості. Для цих дебатів автономію краще

описати простими термінами. Система автономна, якщо вона має широкий спектр

своїх цілей і може їх досягати. Я маю на увазі системи, які зможуть не лише

ставити цілі, а й досягати їх, усупереч Деновій візії

штучного інтелекту як засобу, що лише радитиме вам, як досягати ваших

власних цілей. Я не впевнений, чи для цього потрібна свідомість. Якщо ви

матимете системи з власними цілями і здатністю їх досягати, цього буде цілком

достатньо, щоб почалась забава. Деннет: Коли

ви порівнюєте «старий-добрий» штучний інтелект із сучасним, то між ними є

велика різниця. Сьогоднішнє глибинне навчання – це лишень чудові інструменти

розпізнавання структур. Вони прекрасно вміють шукати голку в копиці сіна і

роблять ще багато неймовірних речей, але вони ще не стали архітектурою, яка б

нагадувала суб'єкта з власними цілями. Існують, щоправда, два способи, як можна

цього досягнути. Ви можете повернутися до «старого-доброго»

штучного інтелекту і сказати: ось у нас є тканина – як нам тепер з

неї щось пошити? У цьому разі вам доведеться програмувати машину «зверху вниз».

Вам потрібно буде зрозуміти, які б ви хотіли інсталювати у неї цілі, а також

вам доведеться обмежити її правилами

Азімова. Це – один зі способів. Це дуже складно – набагато

складніше, ніж більшість людей це собі уявляє. Інший спосіб – рухатися «знизу

вгору»: нехай система сама розвивається і навчається якимсь квазідарвіністським

спосом. Якщо ми рухатимемося цим напрямком, то знатимемо з самого початку, що

цей процес нам непідконтрольний. Як наслідок, ми запустимо процес, де кількість

автономії, яку матиме система, обиратимемо не ми. Я ще не боюся цього

просто зараз, оскільки прогнози можливостей таких систем здебільшого

хибні. На шляху реалізації їхнього потенціалу стоять

складнощі неймовірного порядку. Візьміть, для прикладу,

«Ватсона». Я не знаю, скільки людино-століть пішло на створення цього

робота, який ще й споживає енергію невеликого міста. Але який відсоток розумної

свідомості у ньому є? Я б сказав, що лишень невелика частка відсотка. Щоб

перетворити його на справжнього розумного суб'єкта, потрібні такі обсяги

енергії та ресурсів, які нам поки що навіть складно уявити. Чалмерс: «Ватсон»

– це приклад того, що називають інженерією знання. Дайте йому достатню базу

даних і добрі алгоритми користування цими даними, і він зможе використати їх

найнемовірнішим способом. Деннет: Він і

справді робить фантастичні речі. Це – чудове знаряддя. Чалмерс: Ви

бачили рекламу IBM? «"Ватсон" робить те, "Ватсон"

робить се». Є десь біля сорока чи п’ятдесяти «Ватсонів». З цього погляду,

«Ватсон» — це щось схоже на бренд. Деннет: І на

хайп, якщо висловлюватись ввічливо. Чалмерс: Людей

зараз захоплює машинне навчання, де ви маєте системи із багатьох даних і

навчаєте їх робити певні речі. Під людським наглядом такі системи вже тепер

приходять до дивовижних результатів, наприклад, у класифікації зображень. Навчання з

підкріпленням, яке використали у AlphaGo і AlphaZero і в якому

штучний інтелект навчав себе сам на основі виграних і програних партій, як

виглядає, може бути цілком достатньо, щоб він вчився навіть без людського

нагляду. Ви праві, що у процес навчання тут включаються еволюційні механізми й

він стає неймовірно складним і непередбачуваним. Коли ви маєте машинне навчання, ви

завжди щось оптимізуєте.

У машинному навчанні є так звана цільова

функція. Ідеалом поведінки системи є повністю розпізнати увесь набір

тренувальних зображень, правильно класифікувати мову або виграти усі партії в

Ґо. Це і є цільова функція. Рано чи пізно машинне навчання досягатиме її дедалі

краще. І це залежатиме не від нас. Цільова функція залежить від нас лише у тому

сенсі, що ви хочете щось максимізувати для вашої системи або змоделювати її

поведінку. Як тільки ці системи отримають автономію, тобто здатність ставити

власні цілі і досягати їх, на нас, як на творців штучного інтелекту, ляже

величезна відповідальність за те, щоб ці цільові функції працювали

правильно. Іншими словами, штучний інтелект повинен мати правильні цілі.

Наприклад, ціллю самокерованого автомобіля є не лише завести вас з пункту А в

пункт Б, але й також не збити по дорозі пішохода, дотримуватися правил

дорожнього руху і т. д. Як тільки ви матимете системи з людським ступенем

автономії, ви захочете, щоб вони працювали бездоганно. Зрозуміло, що програмувати наші

системи правильними цілями і цінностями стане дуже великим викликом, і саме тут

ми маємо справу з усім цим хаосом «сирого» сприйняття. Як люди, ми не маємо

якоїсь єдиної цільової функції, натомість у нас їх багато. Ми прийшли у

світ не внаслідок прямого задуму, а після тривалої еволюції, кінцевою метою

якої є кількісне поширення наших генів. Утім, вздовж нашого шляху постійно

виникає певна кількість малих і хаотичних цільових функцій. Цілком

можливо, що якась форма штучної еволюції зрештою породить штучний інтелект,

який буде настільки ж сирим і хаотичним, як і біологічні системи. Люди

настільки непередбачувані, зокрема в міжнародному та соціополітичному

контексті, що такий штучний інтелект був би справді не надто доброю річчю. У

певний момент у нас може виникнути бажання мати простіший штучний інтелект з

простими цільовими функціями. У такому разі ми принаймні зможемо його

розуміти. Брокман: Підзаголовок

цього вечора такий: “Філософія та штучний інтелект”. Тож у

мене до вас є питання: Як ви розрізняєте свою роботу як когнітивних

науковців та як філософів? Дозвольте, я розкажу вам історію.

Двадцять п’ять років тому я написав книжку під заголовком «Третя культура», в

якій один розділ був написаний спільно із Деном. Я звернувся до інших

співавторів книги і попросив їх поділитися, що вони думають одне про одного.

Марвін Мінський відповів на мій телефонний дзвінок, і коли я запитав його про

Дена, він сказав: «найбільший філософ з часів Рассела». Через шість місяців я

робив фактчекінг, і коли я знову звернувся до Мінського і процитував йому його

ж слова, він сказав: «Я мав на увазі не лише те, що він є видатним філософом,

а й те, що він єдиний з них, хто розуміє те, що ми робимо». Ви – один із тих, хто займається

реальними справами. Тож де закінчується когнітивна наука і починається філософія?

Давайте поговоримо про роль філософії у штучному інтелекті, оскільки,

признаюсь, я не зовсім її розумію. Деннет: У філософії є

одна підгалузь, яка настільки злилась з когнітивною наукою, що, по суті,

зайняла ту ж позицію щодо неї, яку теоретична фізика займає щодо

експериментальної. Ви розповідаєте про людей, які вивчили своє «домашнє

завдання» і знають технології. Вони мають руки, щоб писати коди, але їх

цікавлять також теоретичні питання, а ще допомога інженерам та іншим людям, які

займаються штучним інтелектом і намагаються зрозуміти, з чим вони мають справу. Мені дуже пощастило, що протягом

останніх тридцяти-сорока років я вчився у лідерів цієї справи. Я не є хорошим

програмістом, хоча трохи вмію писати програми. Теперішнє покоління філософів та

когнітивних науковців – це чудово освічені люди, які знають набагато більше,

ніж я і Дейв, коли ми лише починали цим займатися. Наприклад, сьогодні я читав

дисертацію про прогностичне опрацювання та гіпотезу Баєсівського

мозку. Це була дуже технічна дисертація, яку написав філософ. Брокман: Це не

принесе вам Премію

Берґруена. З погляду філософського істеблішменту, я не бачу, щоб

хтось, хто займається штучним інтелектом, міг би отримати одну з їхніх премій. Чалмерс: Я

думаю, що ви помиляєтесь. Багато філософів, які міркували про розум, займалися

також і штучним інтелектом. Ден – найкращий тому приклад. Він є одним з

провідних філософів розуму на нашій планеті, а велика частина його досягнень

походить саме від міркувань про штучний інтелект. Це була одна з основних

філософських тем кількох останніх десятиліть. Я написав дисертацію на тему

штучного інтелекту. Мій науковий керівник був академічним філософом. Це був

дослідник штучного інтелекту, когнітивний науковець і письменник Дуґлас

Гофштадтер, відомий загалу завдяки своїй книзі «Ґьодель. Ешер. Бах». Він також

у парі з Деном написав книгу «Я розуму». Хоча вже кілька десятиліть я не пишу

програми, але цей досвід «забруднення рук» і створення таких систем надзвичайно

мені допоміг. Моїм технічним знанням тепер тридцять років, але вони дали мені

щось, з чого я міг розпочати. Таким способом філософи можуть набути знань з

інженерії та природничих наук і зробити у них свій внесок. Велика частина штучного інтелекту та

когнітивних наук присвячена створенню програм, але є ще й інша частина, яка

запитує, що вони можуть розказати, наприклад, про людський розум. Це вже більше

не інженерія. Це – наука і філософія. Ми починаємо краще розуміти, як

співвідносяться природні і штучні системи. Ден зробив дуже багато у цій сфері,

тоді як інші, зокрема Джон Серль,

стверджують, що комп’ютери узагалі нічого нам не кажуть про людський розум та

свідомість. У будь-якому разі, нам потрібні філософи, щоб пояснити, що усе це

означає. Є також соціальні, політичні та

моральні аспекти, які стосуються не лише того, які системи штучного інтелекту

ми можемо створити, а й того, як ми повинні створити. Ден часто

висував свої пропозиції у цій сфері. Дехто може мати інші пропозиції, але хтось

повинен розмірковувати над етичними питаннями, які включають, зокрема, рефлекцію

над людськими цінностями. Що ми хочемо як суспільство? Філософи знають, як

мислити про цінності, і це стає однією з центральних тем і для штучного

інтелекту. Брокман: Це

дуже корисно. Деннет: Це

також надзвичайно цікаво, адже протягом минулих років до сфері штучного

інтелекту був і філософський інтерес. Багато людей воліють бути лишень

інженерами і прагнуть уникати філософських питань. Це, однак, не означає, що

вони не роблять чудової роботи. Втім, багато з них позіхають, як тільки мова

йде про щось, що стосується когнітивних наук та розуму. Іронія полягає, на мою думку, в

тому, що коли ви повернетесь до ранніх років Герберта Саймона, Алена Ньювелла

та інших піонерів штучного інтелекту, то побачите, що тоді були спроби

розділити сам штучний інтелект та когнітивну симуляцію. Ідея полягала у тому,

що когнітивна симуляція використовує комп’ютери, щоб імітувати людське

пізнання, а штучний інтелект включав би усе, що працювало й працювало добре. Як

виявилось, люди, які займалися когнітивною симуляцією, не придумали нічого

кращого за ці громіздкі моделі GoFi, які не вміють робити нічого путнього, тоді

як люди, які підходили до штучного інтелекту суто інструментально,

винайшли глибинне навчання та інші неймовірні системи, які – як ми тільки

тепер починаємо це розуміти, – можливо, й справді працюють за принципами

людського мозку. Брокман: Дене, Стюарт

Рассел має запитання суто до вас. Стюарт Рассел – це один з провідних

комп’ютерних науковців, якого ми дуже поважаємо. «Здається, що ви розділяєте

системи штучного інтелекту на свідомі об’єкти і знаряддя. Чи є між ними якась

проміжна територія, наприклад, програми-суб'єкти, які мають конкретні цілі в

реальному світі? Такі суб'єкти можуть бути компетентними у своєму невеликому

діапазоні, як, наприклад, AlphaGo, але при цьому не бути свідомими. Чи ви

вірите у те, що свідомість обов’язково «заповзе» у них, як тільки ми розширимо

їхній функціональний діапазон? Чи відомий вам рецепт, як уникнути свідомого

штучного інтелекту? Деннет: Добре

запитання, і я радий, що мені його поставили. Справді, ми можемо створювати

дуже розумні системи, які, щоправда, не є свідомими у якийсь цікавий для нас

спосіб. Але вони можуть здаватися нам свідомими, не маючи, щоправда, тих ознак,

які маємо ми. Це передусім стосується того, чи здатні вони сприймати свої

внутрішні стани як об’єкти для спостереження. Це дуже специфічна риса.

Жодна нелюдиноподібна істота не має такої здатності, і саме тут проходить межа

між людською свідомістю і тваринною чуттєвістю. Я не збираюсь сперечатися про те, де

свідомість починається і де закінчується, але важливо зрозуміти, що багато

технік та структур, які були розроблені в минулому і є такими ж добрими для

аналізу причинності, як і свідомий розум, наприклад, спрямовані

ациклічні графи чи do-обчислень Джуди Перла,

можуть виконуватися несвідомо. Ззовні це виглядає так, наче опрацювання

гіпотези відбувається свідомо, втім ніякої свідомості там немає. Ми можемо

отримати всі ці переваги і без того, щоб система була хоч трішки ознайомленою

зі своїми внутрішніми станами. Брокман: Ви

згадали Джуду Перла, тож до вас запитання від нього самого. Джуда Перл є

батьком Баєсової

мережі, без якої ми сьогодні б не мали штучного інтелекту. Він є

справжнім гігантом у цій сфері. Він запитує: «Чи не надто сміливим є

припущення, що філософія скоро увіллється в штучний інтелект і всі філософські

питання, особливо ті, що стосуються свідомості, зводитимуться до штучного

інтелекту?». Чалмерс: Я б це

питання поставив дещо інакше. Філософія досить добре вміє запускати свої

проблеми в інші науки. Ісаак Ньютон створив блискучі методи для вирішенння

задач часу, простору і т. д., але при цьому вважав себе філософом. Люди

«розкрутили» ці методи і назвали їх фізикоюю. Згодом філософія так само відбрунькувала психологію та лінгвістику. Таке

відбрунькування жодним чином не вирішило

первісних філософських проблем, однак ми побачили, що певна частина з

них є податливою і в ній можна створити методи, з якими погодилися би всі люди,

хоча досі їхні думки були розділені. Чи фізика вирішила всі філософські

проблеми часу і простору? Звісно, що ні. Найбільші з них залишаються

невирішеними. Чи психологія розв'язала проблему дихотомії розуму і тіла? Теж

ні. Нині є стільки ж поглядів на цю проблему, скільки було в минулому. Чи

штучний інтелект розв’яже усі проблеми свідомості? Я майже впевнений, що не

розв’яже, принаймні не сам по собі. З іншого боку, я переконаний, що він

надасть нам чимало нових здогадок. Ми отримаємо безліч систем на основі

штучного інтелекту, які поводитимуться так, наче вони і справді свідомі, а

дехто навіть подумає, що є добрі підстави вважати їх свідомими. Але нам

однаково буде потрібна філософія, щоб мислити про них таким чином. Тут ми знову повертаємося до нашого

вихідного запитання: чи ці системи штучного інтелекту і справді можуть стати свідомими?

Хоча це й філософське питання, але ви не зможете від нього так просто

відмахнутися. Чому? У наш людський моральний компас глибоко вкорінене уявлення

про моральний статус суб’єкта. Цього статусу йому надає свідомість. Якщо

комп’ютерна система не має свідомості, тоді це просто річ, яка не претендує на

моральний статус. Але якщо система свідома, тоді вона вже входить в моральну

сферу й ви повинні про неї піклуватися. Тож якщо більшість систем штучного

інтелекту стануть свідомими, ми вже не зможемо просто їх

використовувати яко речі, а маємо замислитися про усі ці моральні

запитання: Чи мають вони права? Чи заслуговують на повагу? Я підозрюю, що коли системи штучного

інтелекту розвинуться настільки, що вони будуть все більше здатні до

рефлексії над власними процесами та до розумування, вони матимуть

відчуття, що є власне свідомими системами. Можливо, ми з ними навіть

зможемо порозмовляти. Я собі уявляю цю розмову десь так: «Ви кажете, що ви –

люди. Звідки ви це знаєте?». Можливо, вони навіть почнуть розмірковувати над

філософією: «Я прочитав інструкцію свого власника. Там сказано, що я лишень

набір мереж. Але я себе відчуваю чимось більшим». Брокман: Для вас

це кваліа. Деннет: Є одна

річ, яку, на мою думку, ви недооцінили. Коли я працював з Робом Бруксом над

роботом Cog,

у всій цій справі мене найбільше дивувало те, як легко переконати більшість

людей, що робот може бути свідомим. Cog і за милю не мав свідомості, але під

враженням від нього студенти з MIT почали міркувати про моральний статус

роботів. Поведінка Cog’а і справді переконливо нагадувала свідому. Коли ви

перебували в кімнаті, де був Cog, він супроводжував вас поглядом. Багатьох

це лякало. Хтось хотів потиснути йому руку. Якось я взяв свою асистентку в

лабораторію, де був Cog. Його рука навіть не була під’єднана до плеча і просто

лежала на столі. Я запропонував їй потиснути його руку. Вона підійшла, потисла

руку, а тоді відскочила і закричала: «Воно живе!». Отже, я не впевнений, що у

вас будуть проблеми з тим, щоб переконати людей, що роботи свідомі і мають моральні

права. Проблеми радше будуть у тому, щоб переконати їх, що вони не мають

свідомості. Ви недооцінюєте темп прогресу. Чалмерс: Існують

психологічні дослідження, які показують, коли саме люди починають вважати, що

система свідома і має суб’єктивний досвід. Один з основних факторів –

присутність очей. Якщо система має очі, нам набагато легше повірити, що вона

свідома. Щойно ми створимо наші перші системи штучного інтелекту і

вмонтуємо їх в роботів з очима, в людей з’явиться майже непереборне

бажання вважати їх свідомими. Натомість ми значно менше схильні вважати

свідомими не виконані у «тілі» системи. Існує впливова організація «Люди

за етичне поводження з тваринами». Я думаю, що пора уявити собі її аналог:

«Люди за етичне поводження з системами навчання з підкріпленням». Ідея полягає

в тому, що коли ви відправляєте системі негативний сигнал, ви приносите їй

певну частку «страждань», а коли позитивний – «винагороду». Ми повинні

переконатись, що «винагороджуємо» свої системи більше, ніж приносимо їм

«страждань». Можливо, це і не найкращий спосіб міркування про свідомість, але

нам однаково доведеться думати про ці питання. Коли ми дійдемо до рівня

справжніх автономних суб'єктів, як сказав Ден, нам доведеться ставитись до

них як до свідомих, а це висуне дуже багато складних

соціально-філософських питань. Брокман: Ми

говоримо про етику, а етичний «слон в кімнаті» – це етика «Великої

п’ятірки» й те, що вони роблять з нашими даними і як

програмують нас без нашої згоди та голосу. Дозвольте мені навести цитату з

книги Джорджа Дайсона: «Норберт Вінер був неймовірно

розчарований "ґаджетообожнювачами", чий корпоративний егоїзм

приніс "мотиви до автоматизації, які виходять за межі легітимної цікавості

і є гріховними самі по собі". Він знав, що загроза майбутнього полягала не

у тому, що машини ставатимуть схожими на людей, а в тому, що люди будуть

подібні на машини. "Cвіт майбутнього стане дедалі вимогливішою боротьбою

проти обмежень нашого інтелекту, а не комфортабельним гамаком, на якому ви

зможете лежати і чекати, коли прийдуть роботи-раби"», – писав він. Прокоментуєте? Деннет: Книгу

Вінера я прочитав, ще коли був студентом. Окремі есе у ній по-справжньому

страшні. Люди повинні читати ці есе і вирішувати для себе, чи, бува, не треба

посадити прихильників безмежного технологічного поступу навпроти себе і

спробувати відрадити їх від майбутнього, яке вони нам обіцяють. Перед нами

постали деякі дуже серйозні проблеми, і ми також повинні поставитись до них не

менш серйозно. Чалмерс: Він говорить

про людей, яких трактують як машини. Я не думаю, що до мене

ставляться як до машини. Я думаю, що я поступово стаю машиною. Половина

моїх спогадів тепер зберігається або в моєму телефоні, або у «хмарі». Я

цікавився тим, хто ж контролює більшу частину мого мозку. Чи це Google, Apple,

чи Facebook? Я думаю, що це може бути Google. Вони отримали дуже багато моїх

спогадів, моїх планів, мою календарну систему, мою навігацію і т. д. Ми всі вже

давно стали цими гігантськими екзо-організмами з цим гігантським

екзо-кортексом, як про це сказав Чарльз Строс. Я нікуди не піду без

консультувань з інтернетом разів п’ять чи десять. Ці корпорації і справді

володіють великою частиною мого розуму. Якщо вони захочуть зробити з ним щось

погане, у мене будуть великі проблеми. Ми дійсно

потрапили у ситуацію, коли ми повинні віддати їм велику частину нашої довіри. Брокман: Але

якщо вони і справді захочуть зробити з цим щось погане? Чалмерс: Вони,

власне, вже роблять з цим невеликі погані речі. Вони ще не забирають мій розум

і не перепрограмовують його. Звісно, вони промивають нам мізки шматочок за

шматочком через алгоритми Facebook та цільову рекламу. Я не думаю, що великі

корпорації мають ще якісь зловмисні цілі, а не тільки структурні стимули. Але

якщо хтось по-справжньому зловісний отримає контроль над цими системами, тоді

ми й справді житимемо в дистопії. Запитання: Що цей

екзо-кортекс означатиме для біології у довготерміновій перспективі, коли

технології щораз більше інтегруються у людей, а технічний прогрес рухається

швидше, ніж генетична еволюція? Чалмерз: Настане

те, що наші мізки поступово переміщатимуться у комп’ютерні системи. Поки це

лишень невеликі частини мозку – спогади, планування та навігаційні системи. Ми

досі маємо це свідоме ядро, яке здебільшого укорінене в біології, і ми досі

реалізуємо свободу волі (якщо, звісно, коли-небудь вона у нас була). У тривалішій

перспективі у комп’ютер може мігрувати навіть це свідоме ядро. Зрештою, якщо ми

дійдемо до епохи, коли штучний інтелект перевершуватиме людський розум, наша

біологія почне регресувати. Нам доведеться вирішити, чи справді ми б хотіли

стати одним цілим із комп’ютером. Це

потенційно дозволить нам стати безсмертними і дасть змогу опрацьовувати

інформацію з неймовірною швидкістю. Дехто, звісно, розглядає це як дистопію, а

інші – як форму смерті. Можливо, ці завантажені системи не будуть свідомими.

Може, це буде не моє «Я», а хтось інший – якась моя копія або близнюк. Ден

прекрасно написав про це у своїй роботі «Де перебуває Я?». Нам вочевидь будуть

потрібні філософи, щоб думати про усі ці питання. Я передчуваю, що колись

настане момент, коли люди читатимуть стародавні філософські тексти, як-от

твори Дерека

Парфіта про ідентичність чи «Де перебуває Я?» Дена Деннета,

щоби приймати цілком практичні рішення. Брокман: Ви б хотіли бути на DVD чи щоб

вас стрімили? Деннет: Не маю нічого

додати до того, що сказав Дейв. Але перш ніж шукати відповідь на це запитанння,

варто глибоко вдихнути і нагадати собі, яким неймовірно складним є наш мозок.

За останнім підрахунком, він складається з 86 млрд нейронів. А є ще глії та астроцити,

які, за даними останніх досліджень, теж відіграють роль у пізнанні. Якщо це

так, то ми досі вивчали телефонну систему, обходячи увагою самі комунікації.

Коли я почав міркувати про роботу мозку, то мав цю просту й елегантну

модель «логічних

нейронів» Маккалоха-Піттса. Я думав, що

розумію, як це працює, і не хотів, щоб ця модель ставала складнішою. Але тепер

вона ускладнилася на багато порядків. Коли тепер стає зрозуміло, що навіть

віруси беруть участь у роботі мозку, ви розумієте, наскільки спрощеними є наші

теоретичні моделі. Чалмерз: Усе це є у

квантових суперпозиціях, Дене. Деннет: Ні, це

не так. Я проведу тут лінію. Брокман: Венкатраман

Рамакрішнан, президент Лондонського королівського товариства та

лауреат Нобелівської премії з біології за дослідження рибосом,

має запитанння про еволюцію: «Чи можна вважати еволюцію вуглецевого розуму лише

каталізатором еволюції кремнієвого розуму, здатного процвітати у набагато

екстремальнішому середовищі? І чи взагалі "розум" є метою еволюції?»

Розповідаючи в інтерв'ю зі мною про свою роботу в лабораторії MRC, де створюють

віруси, Рамакрішнан сказав: «Глибинне навчання є цілком непрозорим. Ми не

можемо йти цим шляхом. Нам потрібно знати кожен свій крок і перевіряти його.

Просто тепер – це проблема». Деннет: Проблема

– у науці «темної скриньки». Ви її не назвали, але можна сказати, що ви її тут

підіймаєте. Завдяки глибинному навчанню ви можете делегувати «темним скринькам»

знаходження закономірностей у найрізноманітніших наборах даних. Що найважливіше

– ми не знаємо, як ці системи працюють. Ми створюємо оракули і довіряємо їм. Ми

можемо навіть мати докази, що їм можна довіряти і вони дають загалом добрі

відповіді. Але все це применшує роль окремого науковця, а також розпорошує

результати досліджень. Ми дедалі більше відходимо від індивідуального розуму і

маємо справу натомість з розпорошеним розумінням, в якому жодна людина не

розуміє результатів дослідження, а лише команда науковців. Це змінює структуру

науки і може зробити те саме навіть з філософію. Можливо, у майбутньому навіть

перестануть давати Нобелівські премії. Чалмерз: Запитання

про еволюцію є доволі цікавим. На зміну біологічній еволюції приходить

культурна еволюція, яка постійно прискорюється, – розвиток мови, згодом

писемності, поява комп’ютерів та ін. Тож я не здивуюсь, якщо культурна еволюція

і надалі залишатиметься актуальною. Але якщо я не помиляюсь у своєму баченні

штучного інтелекту, то можна очікувати, що у певний момент у майбутньому на

зміну культурній еволюції прийде еволюція штучного інтелекту, який

розвиватиметься стрибкоподібно: перші системи створять люди, а згодом вони

рекурсивно удосконалюватимуть самі себе. Ця еволюція може виявитися ще швидшою,

ніж культурна. Тож питання є таким: Чи справді це є майбутнім людства? Є

версія, що в майбутньому розвиватимуться не люди, а зовсім інші істоти. Деннет: Цю

гіпотезу захищає Сью Блекмор.

Вона пише, що люди-носії більше не будуть потрібними, щоб поширювалися меми, і

ми матимемо справу з тим, що вона називає «темами» або мемами, носіями яких

будуть самі технології. Вже сьогодні, наприклад, існують алгоритми, які

дозволяють передбачити популярність пісень. Може настати день, коли пісня стане

платиновою ще до того, як її хтось послухає. Брокман: Це має

шанс стати найпопулярнішою ідеєю цього вечора. Чалмерз: Я б

хотів жити у майбутньому, в якому ми знатимемо про пісню, і хтось зможе її

послухати, оскільки саме у ньому цей «тем» матиме цінність. Запитання: Чи є

якась регуляція штучного інтелекту американським чи будь-яким іншим урядом?

Дейв сказав, що штучний інтелект доглядатиме за старенькими. Я знаю, що дедалі

популярнішими стають секс-роботи. Чи може все це призвести до майбутнього, в

якому люди більше не матимуть значення? Що ми, звичайні люди, можемо зробити,

щоби це не настало? Чалмерз: Це

добре запитання. Зараз відбуваються багато різних дискусій довкола регуляції

штучного інтелекту. Етика штучного інтелекту стала напрочуд популярною протягом

кількох минулих років. Приблизно два роки тому я брав участь у конференції,

присвяченій розробці етичних принципів, які повинні спрямовувати розвиток

штучного інтелекту. Ми розробили двадцять три таких принципи. Існує так зване

«Партнерство штучного інтелекту» – неприбуткова організація, в якій беруть

участь, зокрема, провідні технологічні компанії світу: Google, Facebook,

DeepMind та ін. Довкола цих етичних принципів є багато скепсису, адже про них

легко говорити – але чи справді їх хто-небудь втілюватиме, особливо якщо будуть

присутні значні фінансові чи військові спокуси? «Уникнути гонки озброєнь

штучного інтелекту» – це один з двадцяти трьох принципів. Така гонка може піти

цілком непередбачуваним шляхом. Уявіть, що між США і Китаєм почалася військова

гонка штучного інтелекту? Чи й справді ви думаєте, що хтось скаже: «О, а є ж ця

пропозиція з семінару»? Я якось

виступав в академії у Вест-Пойнті й запитав тамтешніх військових, як вони

ставляться до суперінтелекту та сингулярності. Чи є щось таке, що ми повинні

попередити? Вони відповіли, що ні. Їхнє ставлення таке: краще, щоб був

американський суперінтелект, аніж китайський. Я не знаю, що може зробити

звичайний громадянин просто зараз, щоби цьому запобігти, але думати про цю

проблему, говорити про неї і тримати її у публічній площині, як на мене, є

досить добрим першим кроком. Запитання: Я не

знаю, як це сформулювати, але, на жаль, це може стосуватися складнішого

запитання про свідомість. Ви говорили про перспективу завантаження розуму в

комп’ютер. Мені складно це зрозуміти, адже навіть якщо ви зможете мене

клонувати і відтворити з усім моїм досвідом, то хіба ця особа матиме мою

свідомість? Це може бути хтось, хто матиме мої спогади, мої думки, але «мене»

більше не буде. Деннет: Уявіть

собі, що це відбувається з вами поступово. Ваш мозок повільно вмирає, і завдяки

технологіям ви завантажуєте його шматочок за шматочком в комп’ютер. Ви звикаєте

до факту, що тепер частина вашого мозку міститься у

хмарі і взаємодіє з вами через зовнішній інтерфейс. Зрештою ваш біологічний

мозок помре повністю й остаточно переміститься туди. Це – одна можливість. Якщо

міркувати про це у такий спосіб, то ви неначе «корабель

Тесея» й вступаєте прямо у нове життя. Чалмерз: Якщо

мені коли-небудь доведеться завантажити себе у комп’ютер, то я б зробив це

нейрон за нейроном, щоби залишатися свідомим у процесі. Ось я ще тут. Але за

мить я вже там. Запитання: Хіба

експеримент «китайська

кімната» не доводить, що переконатись у тому, що система

свідома, практично неможливо? Деннет: Ні, це

не так. «Китайська кімната» – це розумовий експеримент з багатьма вадами. Я не

хочу про це багато говорити. Ви можете прочитати безліч сторінок про те, що не

так з аргументами Джона Серля.

Я знаю багатьох людей, які не хочуть вникати у технічні деталі. Їм просто

подобаються його висновки. Якщо вони теж вам імпонують і ви не хочете

цікавитися технічними деталями, то можете і надалі вірити у цей аргумент – але

тільки не думайте, що він добрий. Чалмерз: Що

може переконати мене, що система свідома? Чимало речей, але, мабуть, найбільше

– можливість поговорити з нею. Звідки мені дізнатися, що людина свідома? Я

спробую з нею поговорити – і вона саме про це мені скаже. Якщо ми

зустрінемо марсіан і спробуємо поговорити з ними, я сподіваюсь, що вони

розкажуть нам про свій свідомий досвід. Якщо система штучного інтелекту скаже,

що дивиться на світ і у неї виникають переживання якісного характеру, то це

переконає мене, що у неї щось є. Я навіть запитаю її, чи вона, бува, не

відчуває червоний колір так, як я відчуваю зелений, і чи не знає, як я відчуваю

запах аміаку, якщо у неї завантажити нейродіаграму. Хоча є ймовірність, що все

це взято з підручника, як пройти тест Тюринга і

створити ілюзію свідомості. Утім, спілкування з системою буде для мене доволі серйозним аргументом, що вона свідома. Запитання: З вашого

попереднього дискурсу можна зробити висновок, що ви вважаєте людське пізнання

ключовим й людина повинна контролювати штучний інтелект, – але ми знаємо, що

люди дуже патологічні у своїх рішеннях. Чи можете окреслити низку проблем, з

якими нам доводиться мати справу зараз, але які застаріють в епоху штучного

інтелекту, адже він прийматиме кращі рішення, ніж люди? Деннет: Я можу

це передбачити – але не впевнений, чи мені сподобається те, що я бачу. Я

навмисне оберу суперечливий приклад. Уявіть собі, що вас судять за особливо

тяжкий злочин. Ви можете обрати, хто має винести вирок – суд присяжних чи

штучний інтелект. Що б ви обрали? Чалмерз: Я б не

хотів, щоб мене судив хтось із тих голодних перед обідом суддів. Деннет: Саме

тому це й цікаве питання. Багато суддів є надто людськими. Запитання: Др.

Деннет, ви раніше говорили, що є різниця між свідомістю й інтелектом.

Суперінтелект не обов’язково має бути свідомим, хоча це й можливо в принципі.

Ви навели приклад Гофстедтера.

Він автор книги «Я у дивній петлі», у якій доказує, що мислення – це і є

свідомість. Тож якщо цей суперінтелект не матиме свідомості, то хіба ж він

мислитиме? Чи не буде це «дурний» суперінтелект? Де проходить лінія між дуже

розумним, але не мислячим суперінтелектом, і, можливо, не таким розумним, але

мислячим та наділеним свідомістю? Деннет: У нас є

тенденція інтелектуалізувати нашу місію і вважати, що мислення – це атрибут

виключно людського мозку, хоча протягом минулих п’ятдесяти років ми дедалі

більше переконуємось, що чимало несвідомих процесів можуть мімікрувати свідому

думку. В одній зі своїх книг, а радше в кількох, я запропонував ідею попперіанського майбутнього,

в якому гіпотези тестуються ще перед тим, як їх випробовують у реальному світі.

Коли люди міркують про це, вони думають, що ці системи «мислять» так само, як

вони. Утім, ви можете отримати усі ці переваги попперіанської істоти цілком

несвідомо. Чи обов’язково називати це «мисленням»? Я вважаю, що ні. Якщо ви

разом з Даґом вважаєте, що мислення – це прерогатива лише свідомого пізнання,

то питання полягає у тому, як отримати особу із усіх тих неймовірних речей, які

відбуваються на підособистісному рівні? Частково відповідь запропонував Жан Піаже,

а британський психолог Ґай Клакстон її

удосконалив: «Інтелект – це коли ви знаєте, що робити, коли ви не знаєте, що

робити». Якщо вам запропонували цілком нову проблему, до якої вас не готували,

і ви починаєте думати, як її розв’язати, – то це і є розум. Це потребує

рекурсій, про які говорили я і Девід. Брокман: Кетрін

Бейтсон недавно запитала: «Чи можна отримати суперінтелект,

який знатиме те, що він не знатиме? Іншими словами, суперінтелект, який отримає

запитання і відповість: “Мені потрібно подумати про це. Дозвольте мені з цим

поспати. Я відповім зранку”». Запитання: Мене дивує,

що стільки дискусій відбуваються довкола «зловмисного штучного інтелекту». Якби

ми могли повернути розмову в інше русло, то що могло б бути продуктивнішою

темою, аніж розмова про штучний інтелект, який стає свідомим і робить погані

речі? Чалмерз: Я не

думаю, що зловмисні агенти – це найбільша проблема. У нас будуть великі стимули

створити дуже потужні системи штучного інтелекту з неочікуваними наслідками. Ця

перспектива турбує мене не менше, ніж сценарій Термінатора, а можливо, навіть

більше, оскільки вона є реалістичнішою. Сценарій Термінатора міг би настати,

якби появився штучний інтелект, чия цільова функція – знищити людство. Але як

сказав Нік Бостром,

може появитися «невинний» штучний інтелект, чия цільова функція – лишень

створювати скріпки для паперу, але цей штучний інтелект вирішить, що люди

займають місце, де могли б бути скріпки. А може появитися штучнийо інтелект,

який вирішить, що його функція – нести людям щастя. Що є атрибутом щастя?

Певно, що посмішка на обличчі. Тож він ходитиме і робитиме усім «посмішки».

Багато речей можуть піти не так, як би нам хотілось, навіть якщо їх створюють з

добрими намірами. Тому нам потрібно дуже ретельно поставитися до контрольних

механізмів. Брокман: Нарешті

останнє запитання. Я б хотів запитати кожного з вас, чи ви навчилися

чого-небудь нового один від одного за цей вечір. Деннет: Я

навчився багато чому від Девіда за роки. Окрім того, що чимало його поглядів

сьогодні стали для мене зрозумілішими, я дізнався, що

між нами є значно більше згоди, ніж я досі собі думав. Чалмерз: Я теж

навчився багато чого від Дена протягом років. Він був одним з перших філософів,

яких я читав ще на колінах у мами. Багато у чому ми згодні, але є речі, в яких

ми сильно розходимось. Свідомість, наприклад, і те, наскільки її можна пояснити

науковими методами. Вона не була у фокусі нашої розмови сьогодні, але однією з

речей, якої я навчився від Дена за сьогоднішній вечір, – це наполегливо думати

про відносини між людською свідомістю і тим способом, як системи мислять про

свою власну свідомість. Ден бачить

усе це як певну ілюзію. Вважати, що у нас є свідомість, – це, власне, і є

ілюзія. Є ілюзія Бога і є ілюзія свідомості. Він вважає, що за цим можуть

стояти якісь глибші істини, але принаймні ці ілюзії породили значні філософські

проблеми. Мені імпонує цей погляд. Він цікавий. Я сам на нього не купуюсь, але

я навчився мислити про свідомість у людських та штучних системах, думати про

механізми, завдяки яким ці системи моделюють наш власний розум, й думати про

наші власні розуми як об’єкти. Як Ден

сказав сьогодні, це правильна перспектива, від якої нам слід відштовхуватись у

нашому осмисленні свідомості, хоча я і Ден пішли різними шляхами від цієї

відправної точки.

Is

Superintelligence Impossible? On Possible Minds: Philosophy and AI with Daniel

C. Dennett and David Chalmers |